Crawl Budget: Warum Google nicht alle Ihre Seiten crawlt

Joel Heuchert

SEO Experte

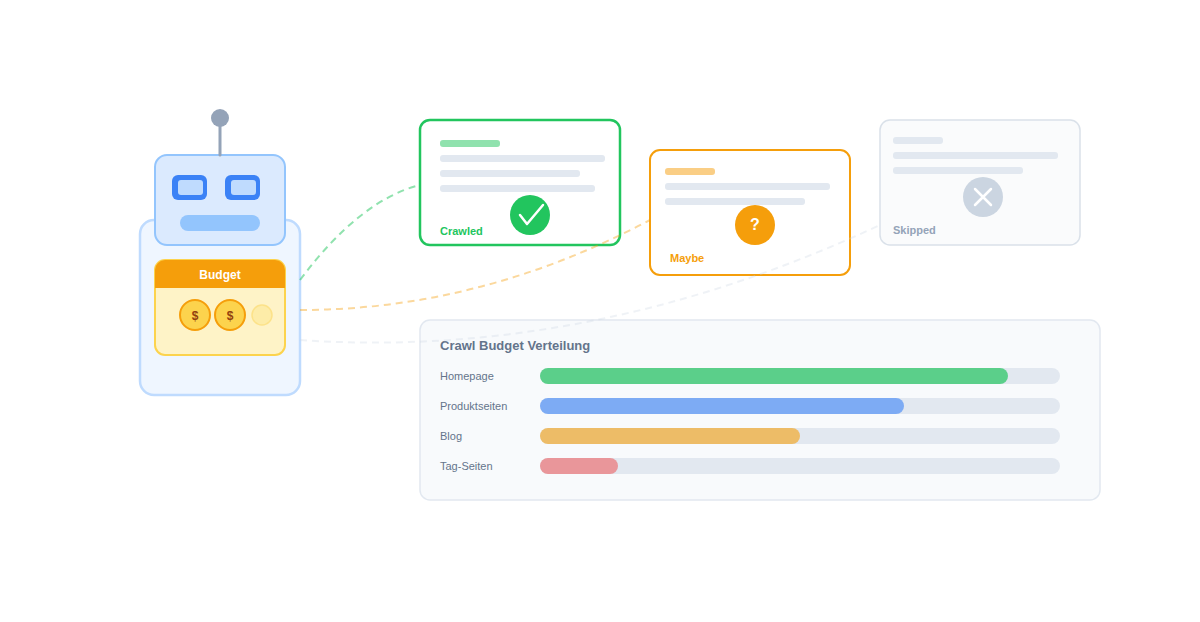

Google crawlt das Web nicht wahllos. Der Googlebot bekommt pro Website ein bestimmtes Kontingent zugewiesen. Wie viele Seiten er in einem Zeitraum besucht, hängt von Ihrem sogenannten Crawl Budget ab. Wer das ignoriert, verschwendet kostbare Crawl-Kapazität auf Seiten, die niemanden interessieren, während wichtige Produktseiten oder neue Artikel zu selten neu bewertet werden. Wir bei SEO Mannheim sehen dieses Problem vor allem bei großen Shops und Content-Heavy-Sites.

Was ist das Crawl Budget?

Das Crawl Budget beschreibt, wie viele URLs der Googlebot einer Website pro Tag crawlt. Google hat dazu offiziell Stellung genommen. Für kleine Websites mit ein paar Hundert Seiten ist das kein Thema. Für große E-Commerce-Shops mit Zehntausenden von Produktseiten kann es entscheidend sein.

Das Konzept klingt simpel. In der Praxis steckt aber mehr dahinter. Google teilt das Crawl Budget in zwei Komponenten auf, die zusammenspielen.

Komponente 1: Crawl Rate Limit

Der Crawl Rate Limit schützt Ihren Server. Google stellt fest, wie schnell Ihre Website auf Anfragen antwortet. Antwortet der Server langsam oder überlastet, drosselt der Googlebot automatisch seine Besuche. Das Ziel ist klar. Google will keine Website durch zu viele gleichzeitige Anfragen in die Knie zwingen.

Schnelle Ladezeiten und ein stabiler Server helfen direkt dabei, dieses Limit hochzuhalten. Die Core Web Vitals spielen hier eine wichtige Rolle, denn sie messen unter anderem die Serverantwortzeit.

Komponente 2: Crawl Demand

Die Crawl Demand beschreibt, wie sehr Google Ihre Seiten crawlen will. Beliebte Seiten mit vielen Backlinks werden häufiger gecrawlt. Seiten, die sich oft aktualisieren, ebenfalls. Stale Content mit kaum Verlinkung landet ganz unten auf der Prioritätsliste.

Beide Komponenten zusammen ergeben das tatsächliche Crawl Budget. Wer einen schnellen Server und relevante, verlinkte Inhalte hat, bekommt mehr Crawls. Wer langsam ist und dünne Seiten produziert, verliert.

Wann ist das Crawl Budget überhaupt ein Problem?

Direkt gesagt. Für die meisten Websites unter rund 1.000 Seiten müssen Sie sich keine Gedanken machen. Google crawlt diese Seiten problemlos durch. Hier lohnt es sich nicht, stundenlang an der Crawl-Effizienz zu feilen.

Anders sieht das aus bei diesen Szenarien.

- Große E-Commerce-Shops. Tausende Produktvarianten, Filterkombinationen und Kategorienseiten erzeugen schnell hunderttausende URLs, von denen viele keinen Mehrwert haben.

- News-Websites und Blogs mit Altlasten. Viele Jahre alter Content, der kaum noch Traffic bekommt, frisst Budget.

- Websites nach einer Migration. Alte URLs, defekte Weiterleitungen und Redirect-Chains verwirren den Crawler und verschwenden Budget.

- Portale mit dynamischen Parametern. Session-IDs, Tracking-Parameter oder Sortierfunktionen in der URL erzeugen exponentiell viele Duplikate.

Wenn Sie in der Google Search Console sehen, dass wichtige Seiten nicht oder kaum gecrawlt werden, lohnt sich eine genauere Analyse.

Was verbraucht das Crawl Budget am meisten?

Das ist die eigentlich wichtige Frage. Wer sein Budget optimieren will, muss zuerst wissen, wer es frisst. Hier sind die häufigsten Übeltäter.

Duplicate Content

Doppelter Inhalt ist der Hauptfeind eines effizienten Crawl Budgets. Wenn dieselbe Seite unter mehreren URLs erreichbar ist, crawlt Google alle Varianten, ohne davon zu profitieren. Das passiert zum Beispiel durch.

- HTTP und HTTPS Versionen der gleichen Seite

- www und non-www Varianten ohne konsequente Weiterleitung

- URLs mit und ohne abschließenden Slash

- Druckversionen von Seiten

Die Lösung sind saubere Canonical-Tags und konsequente Weiterleitungen. Wie Indexierung und Canonicals zusammenhängen, erklären wir ausführlich im entsprechenden Glossar-Artikel.

URL-Parameter

Sortierfunktionen, Filteroptionen und Tracking-Parameter erzeugen eine Flut an URLs, die inhaltlich identisch sind. Ein Shop mit 50 Filtermöglichkeiten kann so schnell Millionen von Kombinationen produzieren. Google crawlt diese URLs alle, wenn Sie sie nicht blockieren.

Die Lösung. Parameter in der Google Search Console konfigurieren oder per robots.txt und Canonical-Tags steuern.

Fehlerhafte URLs und 404-Seiten

Gelöschte Seiten, die noch intern verlinkt sind, zwingen den Googlebot zu nutzlosen Crawl-Besuchen. Jede 404-Seite, die gecrawlt wird, verbraucht Budget ohne Gegenwert. Regelmäßige Crawl-Audits mit Tools wie Screaming Frog decken diese Leichen schnell auf.

Redirect-Chains und Redirect-Loops

Weiterleitungen kosten. Jede Weiterleitung ist ein zusätzlicher HTTP-Request. Mehrere Weiterleitungen hintereinander, sogenannte Redirect-Chains, verbrauchen überproportional viel Budget und verlangsamen zusätzlich das Crawling. Im schlimmsten Fall landet Google in einer Endlosschleife und bricht ab.

Dünne und qualitativ schwache Seiten

Seiten mit wenig oder keinem Mehrwert werden von Google zwar gecrawlt, aber niedrig priorisiert. Tags-Seiten mit nur einem Artikel, leere Kategorienseiten oder automatisch generierte Suchwortseiten senken die Crawl-Effizienz Ihrer gesamten Domain.

Crawl Budget optimieren: So gehen Sie vor

Wir bei SEO Mannheim folgen bei der Crawl-Budget-Optimierung einem klaren Prozess. Zuerst analysieren, dann bereinigen, dann steuern.

robots.txt gezielt einsetzen

Die robots.txt-Datei ist das einfachste Mittel, um den Google Crawler von Seiten fernzuhalten, die er nicht besuchen soll. Typische Kandidaten für die robots.txt sind Admin-Bereiche, interne Suchseiten, Warenkorbseiten und URL-Parameter.

Wichtig zu verstehen. robots.txt verhindert das Crawling. Sie verhindert nicht die Indexierung, wenn andere Seiten auf die blockierte URL verlinken. Dafür brauchen Sie Noindex.

Noindex-Tag für nicht benötigte Seiten

Der Noindex-Meta-Tag sagt Google. "Crawle diese Seite ruhig, aber nimm sie nicht in den Index auf." Das hilft bei Seiten, die Sie zwar erreichbar lassen wollen, die aber nicht in den Suchergebnissen erscheinen sollen. Zum Beispiel Dankeseiten nach Formularabsendungen oder interne Filterseiten.

Vorsicht. Noindex allein spart kein Crawl Budget, wenn Google die Seiten trotzdem besucht. Kombinieren Sie Noindex mit internen Verlinkungsbereinigungen.

Canonicals konsequent setzen

Für Duplikate ist der Canonical-Tag das richtige Werkzeug. Er sagt Google, welche URL die "echte" Version ist. Das konsolidiert den Linkwert und verhindert, dass Google Ressourcen auf Duplikate verschwendet.

XML-Sitemap pflegen

Eine saubere Sitemap zeigt Google, welche Seiten Sie für crawlenswert halten. Nehmen Sie nur Seiten in die Sitemap auf, die tatsächlich indexiert werden sollen. Keine 404-Seiten, keine Noindex-Seiten, keine Redirects. Google nutzt die Sitemap als Prioritätsliste, nicht als Pflichtprogramm.

Interne Verlinkung strategisch aufbauen

Der Googlebot folgt Links. Seiten mit vielen internen Verlinkungen werden häufiger gecrawlt. Wichtige Seiten, etwa Top-Kategorien oder umsatzstarke Produktseiten, sollten intern stark verlinkt sein. Schwache Seiten ohne interne Links werden selten besucht.

Ladezeiten verbessern

Ein schnellerer Server bedeutet direkt mehr Crawls pro Tag. Google kann mehr Seiten in der gleichen Zeit besuchen, wenn Antwortzeiten unter 200ms liegen. Server-Caching, CDN-Einsatz und optimierte Datenbankabfragen helfen hier konkret.

Crawl-Statistiken in der Google Search Console

Google stellt Ihnen die wichtigsten Crawl-Daten direkt in der Search Console zur Verfügung. Den Bericht finden Sie unter "Einstellungen" und dann "Crawl-Statistiken".

Was Sie dort sehen und wie Sie es interpretieren.

- Crawl-Anfragen gesamt. Wie viele URLs Google in einem Zeitraum gecrawlt hat. Ein plötzlicher Einbruch deutet auf Serverprobleme oder robots.txt-Fehler hin.

- Durchschnittliche Antwortzeit. Werte über 500ms sind ein Warnsignal. Optimieren Sie Server und Caching.

- Gecrawlt nach Reaktion. Hier sehen Sie, wie viele Seiten mit 200, 301, 404 oder anderen Statuscodes geantwortet haben. Viele 404-Antworten sind ein direktes Problem.

- Gecrawlt nach Dateityp. HTML, JavaScript, CSS, Bilder. Prüfen Sie, ob Ressourcen gecrawlt werden, die Sie nicht brauchen.

Wenn Sie sehen, dass Google täglich viele tausend URLs crawlt, aber wichtige Seiten trotzdem selten neu bewertet werden, liegt das Problem fast immer an zu vielen nutzlosen URLs.

Praktischer Leitfaden für Shops und große Websites

Für Online-Shops gibt es typische Probleme, die wir bei SEO Mannheim immer wieder antreffen. Hier ein kompakter Aktionsplan.

- Crawl-Audit durchführen. Erfassen Sie alle gecrawlten URLs mit Screaming Frog oder einem ähnlichen Tool. Wie viele sind es? Wie viele davon haben echten Mehrwert?

- URL-Parameter analysieren. Identifizieren Sie alle Parameter, die Duplikate erzeugen. Sortierung, Filterung, Session-IDs, Tracking-Parameter.

- 404-Seiten bereinigen. Alle internen Links auf 404-Seiten löschen oder auf lebende Ziele weiterleiten.

- Redirect-Chains verkürzen. Mehr als eine Weiterleitung hintereinander vermeiden. Direkt auf die finale Ziel-URL weiterleiten.

- Noindex für schwache Seiten setzen. Filterseiten ohne eigenen Content, Suchwort-Seiten ohne Traffic, Duplikate.

- Sitemap bereinigen. Nur indexierbare, wertvolle Seiten aufnehmen.

- Interne Verlinkung auf wichtige Seiten stärken. Umsatzstarke Kategorien und Produkte stärker intern verlinken.

- Server-Performance prüfen. Antwortzeiten unter 200ms anstreben.

Nach diesen Schritten beobachten Sie die Crawl-Statistiken in der Search Console für vier bis acht Wochen. Typischerweise sehen Sie, dass Google weniger URLs crawlt, dafür aber die wichtigen Seiten häufiger.

Fazit: Crawl Budget ist kein Selbstläufer

Das Crawl Budget ist kein abstraktes technisches Konzept. Es ist eine direkte Stellschraube für Ihren SEO-Erfolg, besonders wenn Ihre Website größer wird. Wer Google hilft, die richtigen Seiten zu finden und zu crawlen, wird schneller und häufiger neu bewertet. Das kann den Unterschied machen, ob neue Produkte in Stunden oder erst in Wochen in den Index kommen.

Wir bei SEO Mannheim analysieren Crawl-Budgets als festen Bestandteil jedes technischen SEO-Audits. Wenn Sie wissen wollen, ob Ihre Website hier Potenzial verschenkt, sprechen Sie uns an.